Diễn đàn do Tổ chức Giáo dục, Khoa học và Văn hóa của Liên hợp quốc (UNESCO) tổ chức, nhằm tạo cơ hội để các nhà lãnh đạo và chuyên gia trao đổi, chia sẻ kinh nghiệm về phát triển chính sách quản lý AI. Những sáng kiến của UNESCO, như Đài quan sát AI toàn cầu, Mạng lưới chuyên gia đạo đức AI không biên giới của UNESCO..., được thảo luận tại diễn đàn này. UNESCO nhấn mạnh, quản trị AI đúng cách là một trong những thách thức lớn nhất của thời đại ngày nay, đòi hỏi sự học hỏi và trao đổi kinh nghiệm giữa các nước.

Diễn đàn là sự tiếp nối các nỗ lực của UNESCO nhằm nâng cao nhận thức cộng đồng về quản lý AI. Hồi tháng 9/2023, cơ quan này đã gửi một bản hướng dẫn tới các chính phủ, cảnh báo rằng giới quản lý ở các nước vẫn chưa chuẩn bị sẵn sàng để giải quyết vấn đề đạo đức liên quan việc triển khai chương trình AI tạo sinh trong trường học. Theo cơ quan này, việc dựa vào những chương trình AI tạo sinh thay cho giáo viên có thể ảnh hưởng tới sức khỏe cảm xúc của trẻ em, đẩy các em vào nguy cơ dễ bị thao túng.

Năm 2024 được nhận định tiếp tục chứng kiến sự bùng nổ trong phát triển công nghệ AI với nhiều bước đột phá mới. Một số doanh nghiệp từng đầu tư mạnh tay vào lĩnh vực nhiều tiềm năng này trong năm 2023 bắt đầu thu về “trái ngọt” với kết quả kinh doanh tích cực. Cụ thể, hai đại gia công nghệ là Microsoft và Google công bố báo cáo cho thấy, doanh thu quý IV/2023 tăng mạnh nhờ nhu cầu về dịch vụ điện toán đám mây tích hợp công nghệ AI tạo sinh.

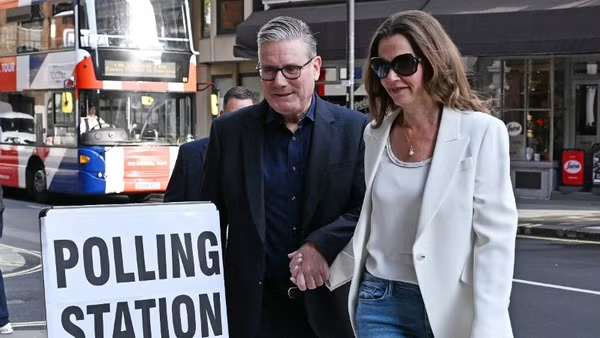

Các nhà hoạch định chính sách ở khắp nơi cũng nghiêm túc và quyết liệt hơn trong thúc đẩy quản lý AI. Mới đây, các nước thành viên Liên minh châu Âu (EU) đã thông qua quy định toàn diện đầu tiên nhằm quản lý AI.

AI có tiềm năng to lớn giúp phát triển kinh tế, thúc đẩy tiến bộ khoa học và mang lại những lợi ích cho xã hội, song cũng đi kèm nhiều rủi ro tiềm tàng nếu không được sử dụng, phát triển một cách có đạo đức và có trách nhiệm. Ngày càng xuất hiện nhiều cảnh báo về nguy cơ từ công nghệ này.

Năm 2023, Trung tâm quốc gia về trẻ em mất tích và bị bóc lột (NCMEC) của Mỹ đã nhận được 4.700 báo cáo về nội dung trực tuyến do AI tạo ra liên quan đến lạm dụng tình dục trẻ em.

Cơ quan tình báo của Chính phủ Anh cảnh báo, sự bùng nổ của các mô hình AI mới gần như chắc chắn sẽ làm tăng số lượng và mức độ tác động mà các cuộc tấn công mạng gây ra trong hai năm tới. Năm 2024 là một năm có rất nhiều cuộc bầu cử như bầu cử tại Mỹ, Nga, Ấn Độ, Nam Phi... Giới chuyên gia nhận định, nguy cơ sai lệch kết quả bầu cử do AI gây ra là một trong những rủi ro lớn nhất trong năm 2024.

Công nghệ tiên tiến này rõ ràng đang khơi mào những cuộc chiến phức tạp mới giữa lực lượng bảo vệ an ninh mạng và tội phạm mạng, khi các đối tượng tội phạm mạng dày dạn kinh nghiệm đang lợi dụng AI để thực hiện hành vi xấu, như phát triển phần mềm độc hại và tấn công lừa đảo. Với sự trợ giúp của AI, các hoạt động phạm tội như bắt chước giọng nói, mạo danh, làm giả tác phẩm nghệ thuật... có thể dễ dàng và tinh vi hơn.

Việc xây dựng chiến lược quản lý, phát triển AI là bước đi cần thiết nhằm chuẩn bị cho các thế hệ sau có thể “sống chung an toàn” với công nghệ này. Tuy nhiên, ngay cả khi nhận được sự ủng hộ từ đông đảo giới lãnh đạo, chuyên gia và doanh nghiệp, thì việc quản lý AI vẫn là điều không dễ dàng. Các nhà lập pháp hiện vẫn có quan điểm khác biệt trong một số vấn đề liên quan đến bảo vệ quyền riêng tư cá nhân và bản quyền. Việc cân bằng giữa thúc đẩy đổi mới, sáng tạo và đáp ứng các tiêu chuẩn đạo đức về phát triển AI cũng là một thách thức, đòi hỏi sự hợp tác quốc tế, chia sẻ kinh nghiệm giữa các nước.