Trong bối cảnh công nghệ số phát triển, lừa đảo trực tuyến ngày càng tinh vi khi deepfake (một công nghệ mô phỏng hình ảnh khuôn mặt con người, được đặt tên theo cụm từ kết hợp giữa “deep learning” (máy học) và “fake” (giả); bị lợi dụng để giả mạo người thân, tổ chức, doanh nghiệp nhằm chiếm đoạt tài sản. Thực tế đó đòi hỏi tăng cường quản lý nền tảng số, hoàn thiện pháp lý và nâng cao kỹ năng, cảnh giác của người dân để chủ động phòng ngừa rủi ro trên không gian mạng.

Theo báo cáo nghiên cứu, khảo sát an ninh mạng năm 2025 từ khu vực người dùng cá nhân do Hiệp hội An ninh mạng quốc gia thực hiện, số nạn nhân của lừa đảo trực tuyến trong năm 2025 đã giảm rõ rệt so với năm 2024. Cụ thể, cứ khoảng 555 người thì có 1 người là nạn nhân lừa đảo, tương đương 0,18%, trong khi năm 2024 là 0,45%. Đây là tín hiệu tích cực, phản ánh nỗ lực chung của các cơ quan chức năng, doanh nghiệp công nghệ, tổ chức xã hội nghề nghiệp và báo chí trong việc nâng cao nhận thức cộng đồng. Tuy nhiên, điều đáng lưu ý là các hình thức lừa đảo không mất đi, mà đang chuyển sang những phương thức tinh vi hơn, trong đó nổi bật là việc lợi dụng công nghệ deepfake để giả mạo hình ảnh, giọng nói và danh tính, gây khó khăn lớn cho người dùng trong việc nhận diện thật-giả.

Theo ông Vũ Duy Hiền, Phó Tổng Thư ký kiêm Chánh Văn phòng Hiệp hội An ninh mạng quốc gia, nhìn vào bức tranh tổng thể về tình hình lừa đảo trực tuyến hiện nay, chúng ta có thể thấy những chuyển biến tích cực, nhưng cũng đối mặt với nhiều thách thức mới. Hiện nay, hình ảnh, giọng nói và video không còn là căn cứ đủ tin cậy để xác thực danh tính. Công nghệ deepfake thường đi kèm với kịch bản tạo áp lực thời gian, nhằm buộc người dùng đưa ra quyết định nhanh chóng và bỏ qua các bước kiểm chứng cần thiết. Do vậy, việc bảo vệ dữ liệu cá nhân có ý nghĩa đặc biệt quan trọng, bởi deepfake chỉ thật sự phát huy hiệu quả khi được nuôi dưỡng bằng dữ liệu thật. Việc chia sẻ tùy tiện hình ảnh, giọng nói và thông tin cá nhân trên mạng xã hội hoặc các nền tảng không rõ nguồn gốc có thể vô tình tạo điều kiện cho các hành vi giả mạo tinh vi.

Deepfake đang trở thành một trong những thách thức nghiêm trọng nhất của kỷ nguyên trí tuệ nhân tạo (AI), khi ranh giới giữa thật và giả ngày càng bị xóa nhòa. Chuyên gia Vũ Duy Hưng - Hưng AI Creative đưa ra nhận định: “Khi mắt thấy, tai nghe chưa chắc là thật. Từ hình ảnh, giọng nói đến video, các công cụ AI hiện nay cho phép tạo ra nội dung giả mạo với độ chân thực cao, dễ tiếp cận và khó phân biệt bằng mắt thường...”.

Không chỉ dừng lại ở nguy cơ lừa đảo trực tuyến, việc quản lý nội dung do AI tạo ra đang nổi lên như một thách thức mới, phức tạp và nhạy cảm. Thực tế cho thấy, một số chatbot AI có thể tạo lập và phát tán sản phẩm deepfake mang tính chất nhạy cảm, xâm phạm nghiêm trọng quyền con người, danh dự, nhân phẩm và quyền riêng tư trên không gian mạng. Trước tình hình đó, yêu cầu đặt ra là phải xác lập cơ chế quản lý phù hợp, hiệu quả, nhằm kiểm soát và giảm rủi ro, đồng thời bảo đảm môi trường phát triển minh bạch, có trách nhiệm và bền vững cho công nghệ AI.

Chỉ ra nguyên nhân của thực trạng này, Phó Giáo sư, Tiến sĩ Trần Thành Nam, Phó Hiệu trưởng Trường đại học Giáo dục, Đại học Quốc gia Hà Nội, chuyên gia Viện Tâm lý Việt-Pháp cho rằng, sống trong một thế giới quá tải về mặt thông tin khiến những người trẻ trở thành mục tiêu lừa đảo trên mạng. Tốc độ và hội chứng FOMO (sợ bỏ lỡ cơ hội) khiến chúng ta thiếu kiểm soát cảm xúc, thiếu cân nhắc rủi ro. Tâm lý đám đông, tin tưởng mù quáng vào những bằng chứng giả trên mạng xã hội, thiếu tư duy phản biện, thiếu tư duy tài chính số, ưu tiên tốc độ hơn kiểm chứng và nhu cầu được công nhận, được chú ý khiến nhiều người trẻ dễ sa vào bẫy của các chiêu trò lừa đảo.

Trong bối cảnh AI tiếp tục phát triển với tốc độ nhanh chóng, việc chủ động trang bị kiến thức, kỹ năng và thái độ đúng đắn cho cộng đồng chính là “lá chắn” quan trọng nhất. Theo các chuyên gia, người dùng cần đặc biệt thận trọng với các yêu cầu chuyển tiền, xác nhận giao dịch hoặc cung cấp thông tin cá nhân được đưa ra thông qua cuộc gọi, tin nhắn hoặc video, kể cả khi các yêu cầu này mang danh nghĩa người quen, lãnh đạo, tổ chức hoặc nền tảng quen thuộc. Việc dừng lại để xác minh thông tin qua nhiều kênh chính thống, hoặc liên hệ trực tiếp với đơn vị liên quan là yếu tố then chốt để giảm rủi ro. Việc nâng cao nhận thức, trang bị kỹ năng nhận diện và xây dựng các biện pháp phòng ngừa, kiểm soát deepfake được nhấn mạnh là yêu cầu cấp thiết trong bảo vệ an toàn thông tin và an ninh số hiện nay.

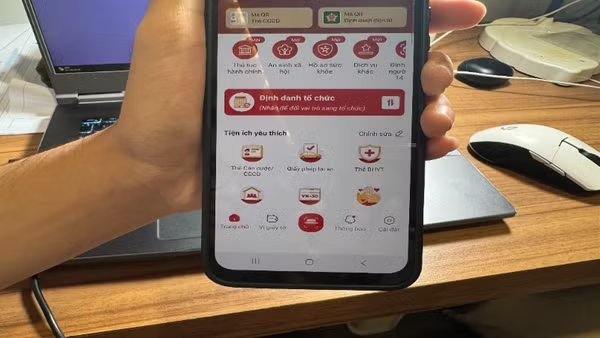

Trước thực tiễn đó, các cơ quan chức năng đã liên tục đưa ra khuyến cáo nhằm bảo vệ người dân khi giao dịch, mua sắm và tương tác trên không gian mạng; đồng thời hoàn thiện khuôn khổ pháp lý về AI. Theo ông Trần Văn Sơn, Phó Viện trưởng Viện Công nghệ số và Chuyển đổi số quốc gia (Bộ Khoa học và Công nghệ), Luật Trí tuệ nhân tạo được Quốc hội thông qua ngày 10/12/2025, có hiệu lực từ ngày 1/3/2026, đã thiết lập cơ sở pháp lý tương đối toàn diện về phân loại rủi ro, xác định trách nhiệm của các chủ thể liên quan và trao thẩm quyền cho cơ quan quản lý trong việc giám sát, can thiệp, xử lý hệ thống AI vi phạm.

Luật nghiêm cấm việc sử dụng deepfake để lừa đảo hoặc thực hiện hành vi trái pháp luật; đồng thời yêu cầu các hệ thống AI tạo sinh phải dán nhãn nội dung do AI tạo ra hoặc chỉnh sửa, áp dụng giải pháp nhận dạng để phục vụ quản lý và truy vết. Bộ Khoa học và Công nghệ là cơ quan đầu mối chịu trách nhiệm trước Chính phủ về quản lý nhà nước về AI, chủ trì hướng dẫn phân loại rủi ro và đánh giá sự phù hợp. Khi phát hiện nguy cơ gây thiệt hại hoặc xảy ra sự cố nghiêm trọng, cơ quan có thẩm quyền được yêu cầu tạm dừng, thu hồi hoặc đánh giá lại hệ thống.

Đối với các hành vi vi phạm nghiêm trọng, nhất là những nội dung xâm hại trẻ em hoặc gây mất trật tự, an toàn xã hội, tổ chức, cá nhân liên quan không chỉ bị áp dụng biện pháp hạn chế, đình chỉ dịch vụ theo Luật Trí tuệ nhân tạo mà còn có thể bị xử lý hành chính, truy cứu trách nhiệm hình sự và bồi thường thiệt hại theo quy định.

Cách tiếp cận này thể hiện rõ quan điểm khuyến khích đổi mới sáng tạo, nhưng kiên quyết không dung thứ cho việc lạm dụng AI xâm phạm quyền con người và lợi ích xã hội, bảo đảm công nghệ được phát triển an toàn, có trách nhiệm và bền vững.

![[Video] Xây dựng Đề án phát triển mô hình "doanh nghiệp một người"](https://cdn.nhandan.vn/images/fe9e98de2d487cb794d38ce785269d0f263b27e1212cd33212a714767e25aff11d58f91d30f3f99e5c4d9b8b3de59621d5300e84676e0ac5c8d1c3c16082c17b/doanh-nghiep.jpg.avif)

![[Infographic] Xu hướng vi phạm và các phương thức, thủ đoạn mới trong lĩnh vực sở hữu trí tuệ](https://cdn.nhandan.vn/images/df05f79295bd61cb5a743bd3b45e042dea4c057d27e65ccf10c6d54828b288854107112cbddcfe282ca36110f4725f9369071fa2faeebd265a61773ff7728ce304f658d8cbfaf00c01b43c9285ad532bdb37bc545d4836dd5ddb6075e31a301c22ccc66d4e2581af9ef20cc195ac8b8463a899dc0d598a8828a44264337440e8/infographic-khung-kho-phap-luat-ve-so-huu-tri-tue-tai-viet-nam-2-7208.jpg.avif)

![[Video] Còn khoảng 34 triệu thuê bao chưa xác nhận chính chủ](https://cdn.nhandan.vn/images/45f6fcc53bd4438c49850db7bb0ae4a6ea0ada0928c9b42d0151d391a681d51c8d6396f6faba7b7628ab64e3b8aebd64bddaa050092951be257b07bca2d04d948b2b5a7f09209eedfdfb0a83e579f450b247e90490a0003ff45f7d38fcd0bb5f/con-khoang-34-trieu-thue-bao-chua-xac-nhan-chinh-chu-2882.png.avif)