“Tuýt còi” AI tạo ảnh

Ngày 26/3 vừa qua, các nghị sĩ của EP đã nhất trí thông qua quyết định liên quan các ứng dụng AI tạo hoặc chỉnh sửa hình ảnh nhạy cảm, mang tính riêng tư của những cá nhân khi chưa có sự đồng ý của họ. Động thái cũng nhằm cụ thể hóa một số quy định trong Đạo luật Trí tuệ nhân tạo (AI Act) của Liên minh châu Âu (EU).

Cuối năm 2025, Ủy ban châu Âu (EC) đã điều chỉnh lộ trình áp dụng các quy định đối với những hệ thống AI có mức độ rủi ro cao thông qua chương trình số hóa toàn diện. Trên cơ sở đó, EP xây dựng kế hoạch triển khai quản lý và thiết lập hành lang pháp lý với AI trong hai năm tới. Điểm đáng chú ý là việc bổ sung lệnh cấm đối với các công cụ được gọi là “AI nuder” (tạm dịch là "AI tạo hình ảnh khỏa thân"). Đây là những phần mềm có thể sử dụng thuật toán để biến đổi hình ảnh người thật thành các phiên bản khỏa thân hoặc mang tính riêng tư, dù những người có trong hình ảnh trên không hề cho phép.

Theo các nghị sĩ của EP, công nghệ này tiềm ẩn nguy cơ xâm phạm nghiêm trọng quyền cá nhân, đặc biệt khi bị lạm dụng trên mạng xã hội. Tuy nhiên, những hệ thống đã tích hợp cơ chế bảo vệ hiệu quả nhằm ngăn chặn việc tạo ra nội dung vi phạm sẽ không bị áp dụng lệnh cấm mới. Điều này nhằm tạo sự cân bằng giữa bảo vệ người dùng và không kìm hãm việc đổi mới công nghệ.

Trước đó, dư luận châu Âu đã đặc biệt chú ý tới vụ việc liên quan đến Grok - AI trên nền tảng mạng xã hội X. Công cụ này có thể tạo ra hàng loạt hình ảnh khỏa thân của người thật theo yêu cầu người dùng, trong đó có cả trường hợp liên quan người chưa thành niên, làm dấy lên lo ngại về kiểm soát nội dung và trách nhiệm của các nhà phát triển AI. Hôm 26/3, một tòa án tại Hà Lan đã ra phán quyết cấm Grok tạo lập và phát tán các hình ảnh khỏa thân, cũng như nội dung khiêu dâm liên quan trẻ em.

Phán quyết áp dụng đối với các nội dung liên quan cá nhân đang sinh sống tại Hà Lan, đồng thời bao gồm cả hoạt động sản xuất và phát tán các nội dung vi phạm trong lãnh thổ nước này. Trước đó, Trung tâm chuyên môn về lạm dụng trực tuyến Offlimits và Quỹ Hỗ trợ nạn nhân trực tuyến của Hà Lan đã khởi kiện theo thủ tục rút gọn đối với Grok, đồng thời kêu gọi ban hành lệnh cấm khẩn cấp ứng dụng này. Các bên khởi kiện cho rằng việc phổ biến các công cụ AI như Grok đang khiến hành vi lạm dụng trực tuyến trở nên phổ biến hơn, đồng thời làm gia tăng số lượng nạn nhân và mức độ nghiêm trọng của các tổn hại tâm lý.

Theo Tòa án quận Amsterdam (Hà Lan), phía Grok và nền tảng X khẳng định đã đưa ra các quy định cấm trong điều khoản sử dụng, đồng thời triển khai các biện pháp nhằm ngăn chặn việc tạo và phát tán nội dung vi phạm. Tuy nhiên, tòa nhận định bằng chứng của Offlimits cung cấp cho thấy hiệu quả của các biện pháp này là không rõ ràng. Tòa án tuyên bố mỗi hành vi vi phạm lệnh cấm sẽ bị xử phạt 100.000 euro (tương đương 115.000 USD) mỗi ngày, với mức tối đa lên tới 10 triệu euro. Đồng thời, nền tảng X phải đình chỉ hoạt động của công cụ Grok cho đến khi đáp ứng đầy đủ các yêu cầu mà tòa án đưa ra.

Phân loại mức độ rủi ro

Những động thái trên đang phản ánh xu hướng siết chặt quản lý các công nghệ AI có nguy cơ bị lạm dụng, đặc biệt trong việc tạo ra nội dung giả mạo và xâm phạm quyền riêng tư trên không gian mạng. Ngoài việc đề xuất cấm sử dụng AI tạo hình ảnh nhạy cảm trái phép, EP cũng xem xét nới lỏng một số nghĩa vụ đối với các sản phẩm vốn đã chịu sự điều chỉnh của các quy định chuyên ngành như thiết bị y tế hay đồ chơi trẻ em, nhằm tránh chồng chéo pháp lý. Tuy nhiên, đề xuất này vẫn gây ra những ý kiến trái chiều trong nội bộ EP, khi một số nghị sĩ cho rằng việc sửa đổi theo hướng hiện nay có thể khiến hệ thống quy định trở nên phức tạp hơn.

Tháng 4/2021, EC đã đề xuất Đạo luật AI đầu tiên trên thế giới, thiết lập hệ thống phân loại AI dựa trên rủi ro. Đạo luật AI của EU có hiệu lực từ tháng 8/2024, theo đó những hệ thống AI có thể được sử dụng trong các ứng dụng khác nhau và phân loại theo mức độ rủi ro có thể gây ra cho người dùng. Mức độ rủi ro khác nhau đồng nghĩa với các yêu cầu tuân thủ luật AI nhiều hay ít hơn. Trong đó, các sản phẩm gắn nhãn ở hai mức độ “Rủi ro không thể chấp nhận được” và “Rủi ro cao” sẽ bị cấm hoặc phải hạn chế.

Những ứng dụng AI gắn nhãn “Rủi ro không thể chấp nhận được” bị cấm tại EU bao gồm AI làm thao túng nhận thức và hành vi đối với cá nhân hoặc các nhóm dễ bị tổn thương, như đồ chơi điều khiển bằng giọng nói khuyến khích hành vi nguy hiểm ở trẻ em; AI chấm điểm xã hội, phân loại người dùng dựa trên hành vi, địa vị kinh tế xã hội hoặc đặc điểm cá nhân… Một số trường hợp ngoại lệ có thể được cho phép vì mục đích thực thi pháp luật.

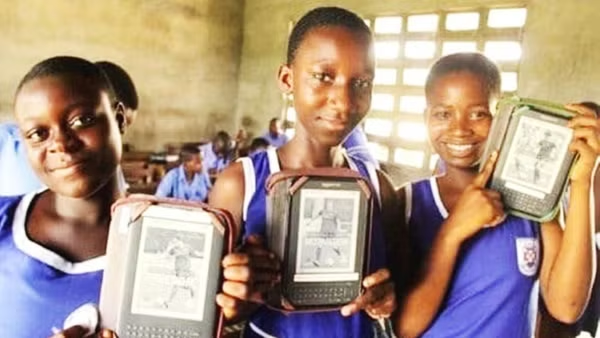

AI gắn nhãn “Rủi ro cao” là hệ thống AI gây ảnh hưởng tiêu cực đến sự an toàn hoặc các quyền cơ bản của người dân, gồm có AI sử dụng trong các sản phẩm như đồ chơi, hàng không, xe ô-tô, thiết bị y tế và thang máy. Những hệ thống AI thuộc lĩnh vực cụ thể sẽ phải đăng ký trong cơ sở dữ liệu của EU, chẳng hạn như AI dùng trong quản lý và vận hành cơ sở hạ tầng trọng yếu, AI giáo dục và đào tạo nghề, AI của cơ quan thực thi pháp luật… Theo EP, tất cả các hệ thống AI rủi ro cao sẽ được đánh giá trước khi đưa ra thị trường và trong suốt vòng đời của chúng.

Tại Hội nghị liên nghị viện “Kỷ nguyên AI” tổ chức tại Cyprus cuối năm ngoái, Chủ tịch luân phiên của hội nghị, Thứ trưởng Bộ Nghiên cứu, Đổi mới và Kỹ thuật số Cyprus, ông Nicodemus Damianou cho rằng: “Thách thức thật sự của AI không nằm ở bản thân công nghệ mà nằm ở cách quản lý. Chúng ta hướng đến tạo hành lang pháp lý nhằm khuyến khích đổi mới sáng tạo tại châu Âu, cho phép các công ty phát triển và thử nghiệm mô hình AI đa năng trước khi đưa ra thị trường”.

Trong thời gian tới, EP sẽ bước vào các vòng đàm phán để thống nhất văn bản cuối cùng liên quan điều chỉnh lộ trình áp dụng quy định đối với hệ thống AI. Kết quả của quá trình này được kỳ vọng định hình khung pháp lý quan trọng cho việc quản lý AI tại châu Âu trong những năm tới. Hiện nay tại EU, AI tạo sinh, thí dụ như ChatGPT của Công ty Open AI, không được xếp vào loại rủi ro cao, nhưng sẽ phải tuân thủ các yêu cầu về tính minh bạch và luật bản quyền của EU. Các nhà lập pháp “lục địa già” cũng thúc đẩy quản lý những nội dung do AI tạo ra, thiết kế mô hình để ngăn chặn việc tạo ra nội dung bất hợp pháp cũng như yêu cầu công bố tóm tắt dữ liệu có bản quyền được sử dụng cho mục đích đào tạo.

Một số mô hình AI đa năng có tác động lớn và có thể gây ra rủi ro hệ thống sẽ phải trải qua quá trình đánh giá kỹ lưỡng và EC yêu cầu báo cáo mọi sự cố nghiêm trọng. Nội dung do AI tạo ra hoặc chỉnh sửa bao gồm hình ảnh, âm thanh hoặc video (như deepfake) cần được dán nhãn rõ ràng là do AI tạo ra để người dùng biết, khi họ bắt gặp loại nội dung này.

Bà Henna Virkkunen, Ủy viên phụ trách công nghệ của EU nhấn mạnh: “Chúng tôi bảo đảm quản lý AI một cách linh hoạt, nghĩa là sự đổi mới phải phục vụ lợi ích công cộng và không bỏ lại ai phía sau. Dựa trên dữ liệu khảo sát năm 2023, hai trên năm người châu Âu coi thông tin sai lệch hoặc gây hiểu nhầm lan truyền trực tuyến và ngoại tuyến là mối đe dọa nghiêm trọng. Những video deepfake hay chiến dịch thông tin sai lệch hiện có thể được triển khai với tốc độ và quy mô chưa từng có. Đây chính là lý do tại sao chúng tôi đang tăng cường biện pháp bảo vệ quản trị kỹ thuật số. Quản trị không phải để kìm hãm sự đổi mới, mà là để định hướng nó”.