Những con số đáng lo ngại

Đầu tháng 2, cảnh sát Hồng Công (Trung Quốc) cho biết, một nhân viên tài chính tại một công ty đa quốc gia đã bị lừa mất 25 triệu USD khi những đối tượng lừa đảo sử dụng công nghệ deepfake giả làm giám đốc tài chính của công ty. Nạn nhân bị lừa tham gia một cuộc gọi video với những người mà anh nghĩ là thành viên khác trong công ty, song tất cả chỉ là sản phẩm của công nghệ deepfake. Do tin tưởng những người dự cuộc họp trực tuyến, nạn nhân đã đồng ý chuyển tổng cộng 200 triệu HKD (khoảng 25,6 triệu USD) cho đối tượng lừa đảo.

Theo CNN, trước đó, nhân viên này nhận được nội dung email được cho là từ giám đốc tài chính của công ty có trụ sở tại Anh và nghi ngờ đó là email lừa đảo. Tuy nhiên, người này đã gạt bỏ mối nghi ngờ ban đầu sau khi tham gia cuộc gọi video bởi những người tham dự họp có vẻ ngoài và giọng nói giống như các đồng nghiệp của anh. Vụ lừa đảo chỉ bị phát hiện khi nhân viên này kiểm tra thông tin với trụ sở chính của tập đoàn.

Đây là một trong những vụ việc gần đây mà các đối tượng sử dụng công nghệ deepfake chỉnh sửa video và hình ảnh, làm giả cả giọng nói, để lừa đảo tài chính. Trên khắp thế giới, ngày càng nhiều báo cáo về những vụ lừa tiền qua cuộc gọi có hình ảnh, giả mạo người thân quen hoặc cơ quan chức năng, nhân viên an ninh… nhằm lấy cắp thông tin cá nhân, bao gồm mã số ngân hàng, mã chuyển khoản.

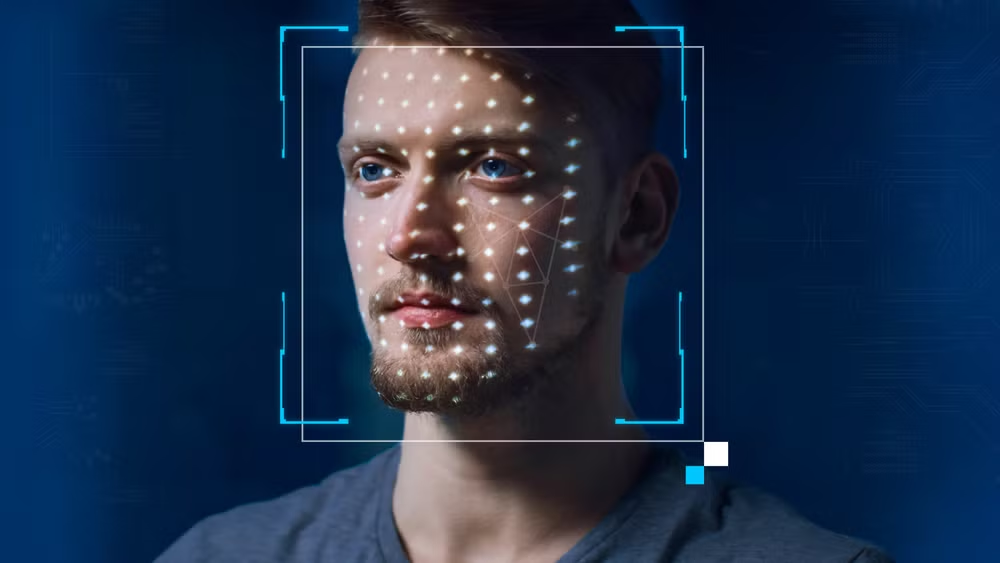

Công nghệ deepfake xuất hiện từ năm 2017 và nhanh chóng trở thành một chủ đề nóng trong cộng đồng công nghệ thông tin. Từ đó đến nay, deepfake đã trở thành một trong những mối đe dọa lớn nhất cho an ninh mạng và đời sống cá nhân của con người. Deepfake là từ ghép của hai từ “deep learning” (học sâu) và “fake” (giả). Deep learning là một phương pháp học máy cho phép máy tính học thông qua việc phân tích và suy luận từ các tập dữ liệu lớn. Deepfake là một kỹ thuật kết hợp giữa các thuật toán học sâu và học máy với mục đích tạo ra những video, hình ảnh hoặc âm thanh giả mạo một cách rất chân thực.

Theo Báo cáo tình trạng gian lận danh tính do Công ty bảo mật dữ liệu Sumsub có trụ sở tại London (Anh) công bố vào tháng 11/2023, nạn lừa đảo sử dụng deepfake diễn ra đáng lo ngại trên toàn cầu, trong đó mức độ sử dụng deepfake tăng đáng kể hơn ở Bắc Mỹ, với tỷ lệ tăng lên tới 1.740% vào năm 2023 so năm 2022; còn ở khu vực châu Á - Thái Bình Dương chứng kiến mức tăng 1.530% so cùng kỳ. Sử dụng deepfake cho mục đích gian lận danh tính đã tăng 450% ở khu vực Trung Đông - châu Phi và 410% ở khu vực Mỹ latin.

“Nhiều kẻ lừa đảo sử dụng deepfake không phải là những cá nhân ngẫu nhiên mà là thành viên của các nhóm tội phạm có tổ chức”, chuyên gia an ninh Ilya Brovin của Sumsub cảnh báo về mức độ tinh vi ngày càng tăng của gian lận tài chính thông qua công cụ deepfake. “Các công cụ AI và deepfake đang trở nên dễ sử dụng hơn và dễ tiếp cận hơn với mọi người. Sự trỗi dậy của AI đang đặt ra yêu cầu định hình lại cách thức thực hiện và ngăn chặn gian lận. AI đóng vai trò là một công cụ mạnh mẽ, song cũng thách thức tất cả các nhà cung cấp giải pháp chống lừa đảo trước tình trạng gian lận tài chính”, ông Brovin nói thêm: “Deepfake mở đường cho các chiến dịch đánh cắp danh tính, lừa đảo và phát tán thông tin sai lệch ở quy mô chưa từng có”.

|

| Một bức ảnh về ca sĩ Taylor Swift do AI tạo ra. Ảnh: GETTY IMAGES |

Hạn chế lừa đảo từ deepfake

Cuối tháng 1 vừa qua, những hình ảnh khiêu dâm do AI tạo ra về ngôi sao nhạc pop người Mỹ Taylor Swift đã lan truyền trên phương tiện truyền thông xã hội, cho thấy nguy cơ gây hại do công nghệ AI gây ra. Đoạn phim giả mạo đã nhận được hàng chục triệu lượt xem, trước khi bị xóa khỏi nền tảng xã hội. Những thiệt hại này không chỉ nhằm vào hình ảnh nghệ sĩ, mà còn phát tán những nội dung độc hại ảnh hưởng môi trường văn hóa trên mạng.

Do đó, lực lượng an ninh mạng của nhiều quốc gia đã đưa ra hàng loạt cảnh báo về sự tinh vi của công nghệ deepfake và việc tội phạm sử dụng với mục đích bất hợp pháp. Đồng thời, khi công nghệ AI tiếp tục phát triển, các chuyên gia cảnh báo về mức độ phức tạp và tốc độ sản xuất deepfake ngày càng tăng cao, vượt xa các quy trình xác minh truyền thống. Điều này khiến cơ quan chức năng nhiều quốc gia gặp khó khăn trong việc ngăn chặn những tác động độc hại từ công nghệ deepfake và AI. Hơn nữa, sự phát triển liên tục của công nghệ deepfake đặt thêm rào cản cho việc phát hiện và giảm thiểu các thông tin sai lệch.

Đáng lo ngại hơn, thông tin giả do deepfake tạo ra thường lan truyền rất nhanh, còn được xem là mối đe dọa mới nổi đối với các cuộc bầu cử và hoạt động chính trị trong bối cảnh tình trạng lừa đảo ngày càng nhiều và liên tục biến tướng. Theo hãng tin Yonhap, từ ngày 29/1 cho đến giữa tháng 2, Ủy ban Bầu cử quốc gia (NEC) của Hàn Quốc đã phát hiện 129 nội dung truyền thông do AI tạo ra với mục đích vận động bầu cử. Điều này đã vi phạm Luật Bầu cử mới sửa đổi và người vi phạm có thể bị phạt tới 7 năm tù hoặc 10 triệu won (7.500 USD). NEC cũng đang nỗ lực chủ động ngăn chặn các tin giả, tin sai sự thật liên quan bầu cử.

Còn về phía doanh nghiệp, hôm 17/2 vừa qua, liên minh gồm 20 công ty công nghệ hàng đầu thế giới, bao gồm cả OpenAI (sở hữu công cụ ChatGPT đình đám), đã ký vào thỏa thuận chung cam kết chống lại deepfake do AI tạo ra, đặc biệt là các thông tin liên quan cuộc bầu cử Tổng thống Mỹ năm nay. Tham gia thỏa thuận còn bao gồm những “gã khổng lồ” công nghệ như Adobe, Amazon, Google, IBM, LinkedIn, McAfee, Meta, Microsoft, OpenAI, Snap, TikTok hay X… Theo UPI, thỏa thuận được công bố tại Hội nghị An ninh Munich (Đức), yêu cầu các tổ chức thành viên phải có biện pháp giám sát chặt chẽ hơn nhằm ngăn chặn những nội dung do AI tạo ra để “đánh lừa” cử tri. Thông cáo của liên minh công nghệ nhấn mạnh: “Sự phát triển nhanh chóng của AI đang tạo ra những cơ hội cũng như thách thức mới cho tiến trình dân chủ. Toàn xã hội sẽ phải tận dụng những cơ hội mà AI mang lại và cùng nhau thực hiện các bước đi mới để bảo vệ bầu cử và quy trình bầu cử trong năm đặc biệt này”.

Hiện nay, trên thế giới đã ban hành nhiều cơ chế, chính sách yêu cầu doanh nghiệp vận dụng các giải pháp an ninh mạng. Cụ thể, giới chức tại Mỹ đã ban hành các chính sách quản lý việc thu thập và xử lý dữ liệu tài chính và thẻ tín dụng, chính sách an ninh mạng cho dữ liệu lưu trữ trên điện toán đám mây... Tại khu vực Đông Nam Á, Hiệp hội các quốc gia Đông Nam Á (ASEAN) đã thống nhất đề ra Chiến lược Hợp tác an ninh mạng bao gồm bảo vệ dữ liệu cá nhân, bảo mật trong lưu trữ dữ liệu, bảo đảm quyền lợi khách hàng liên quan an toàn thông tin.