Đối với nhân quyền

AI là công nghệ cốt lõi của cuộc cách mạng công nghiệp 4.0, ngày càng phát triển nhanh chóng và được ứng dụng rộng rãi, đóng vai trò quan trọng trong nhiều lĩnh vực đời sống xã hội, an ninh - quốc phòng. Sự ra đời của AI và các tiện ích liên quan tác động rộng, toàn diện đến kinh tế - xã hội, địa-chính trị thế giới; là công cụ hữu hiệu kích thích tăng trưởng, động lực chính trong chiến lược chuyển đổi số của nhiều quốc gia. Đáng chú ý, các hệ thống AI còn giúp tăng khả năng dự đoán, phòng ngừa tội phạm, qua đó ngăn chặn các hoạt động phạm tội…

Tuy nhiên, sự phát triển quá nhanh của công nghệ AI cũng mang đến những rủi ro liên quan vấn đề quyền con người. Cụ thể, quyền bình đẳng, không bị phân biệt đối xử bị ảnh hưởng do các hệ thống AI phản ánh các định kiến xã hội và tạo ra sự bất bình đẳng, nhất là đối với các cá nhân, nhóm thiểu số, yếu thế và dễ bị tổn thương. Nhiều bằng chứng gần đây cho thấy người da mầu, khuyết tật, phụ nữ, dân tộc thiểu số và nhóm cộng đồng đồng tính (LGBTQ+) bị AI phân biệt đối xử trong thực hiện chức năng. Hệ thống AI đóng góp vào quyết định của người dùng và đề xuất các khuyến nghị bằng cách sử dụng và đánh giá dữ liệu xã hội, nghề nghiệp, chủng tộc, sức khỏe và mầu da, dẫn đến sự phân biệt đối xử nghiêm trọng đối với các cá nhân và nhóm có hoàn cảnh khó khăn. Chẳng hạn, một hệ thống máy tính được sử dụng ở Mỹ để tiếp cận nguy cơ tái phạm tội của người dân trong hệ thống tư pháp hình sự đánh dấu những người da mầu có nguy cơ tái phạm gần gấp đôi so người da trắng.

Tiếp đó là quyền riêng tư và bảo vệ dữ liệu cá nhân. Hoạt động của hệ thống AI là truy cập và phân tích các bộ dữ liệu lớn (Big-Data). Để hoạt động trơn tru, AI yêu cầu thu thập rất nhiều thông tin và việc phân tích dữ liệu bằng hệ thống AI có thể tiết lộ thông tin, riêng tư cá nhân. Vụ việc hệ thống mạng của Văn phòng Quản lý nhân sự Chính phủ Mỹ (OPM) bị tin tặc tấn công gần đây gây lộ dữ liệu cá nhân chi tiết, nhạy cảm của 21,5 triệu quan chức tại chức và đã nghỉ hưu của nước này, thông tin về vợ, chồng và những người từng nộp đơn xin việc vào cơ quan chính phủ là thí dụ điển hình. Những dữ liệu trên gồm thông tin về sức khỏe, nơi cư trú, công việc, vân tay và thông tin tài chính... Tại Anh, năm 2016, Công ty phân tích dữ liệu Cambridge Analytica đã thu thập trái phép dữ liệu từ 87 triệu người dùng mạng xã hội Facebook để phân tích, hợp tác chặt chẽ với chiến dịch tranh cử Tổng thống Mỹ của ông D.Trump.

Hầu hết hệ thống AI được sử dụng bởi các công ty công nghệ như Google, Facebook, Twitter và nhiều chính phủ. Các doanh nghiệp sử dụng các thông tin cá nhân phục vụ hoạt động kinh doanh và kiếm lợi nhuận, trong khi ngày càng có nhiều chính phủ sử dụng các hệ thống AI để phục vụ quản lý, như hệ thống kiểm soát bằng video, nhận dạng khuôn mặt và sinh trắc học. Sự xuất hiện của các hệ thống kiểm soát AI dẫn đến tình trạng lượng lớn dữ liệu về cá nhân, cả trực tuyến và ngoài đời được lưu trữ, sử dụng sai mục đích và lạm dụng không đúng cách, ảnh hưởng đến quyền tự do cá nhân. Đáng chú ý, AI còn tạo ra các video, hình ảnh giống hệt con người (thông qua công nghệ deepfake), hoán đổi các chi tiết trên khuôn mặt của người này với người khác, thậm chí thay đổi cả giọng nói. Trường hợp bị sử dụng trái phép, “deepfake” có thể là công cụ tiếp tay cho tội phạm lừa đảo, tống tiền, đưa tin sai lệch, ảnh hưởng trực tiếp đến danh dự, sinh kế của nạn nhân.

Về quyền tự do ngôn luận, AI tác động lớn đến quyền tiếp cận, tìm kiếm và chia sẻ thông tin. Nhiều hệ thống AI được thiết kế trong các giao diện mạng xã hội, công cụ tìm kiếm để kiểm soát thông tin người dùng bằng những cách khác nhau. Các công ty internet sử dụng AI để phát hiện, tháo gỡ các thông tin không hợp quy định, đặc biệt theo các yêu cầu pháp luật liên quan vấn đề khủng bố, ngôn từ kích động thù địch, thông tin giả mạo. Tuy vậy, AI cũng có thể sai lầm trong việc loại bỏ các thông tin chính đáng. Thí dụ Facebook gỡ bỏ hình ảnh “Cô gái napalm” (chụp ở Việt Nam) vì cho rằng nó khiêu dâm mà không xét đến ý nghĩa lịch sử của nó. Vấn đề trở nên nghiêm trọng hơn khi quyền kiểm soát thông tin của AI được sử dụng cho các mục đích chính trị nhằm kiểm duyệt và phân phối các thông tin.

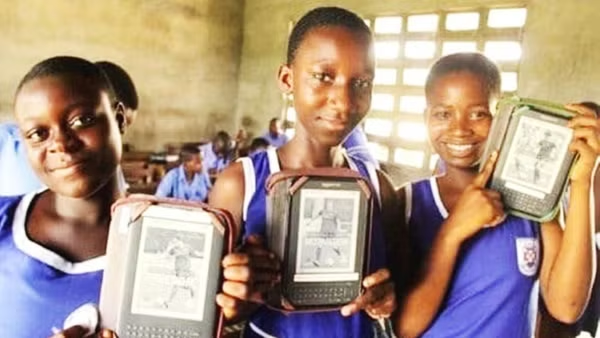

Bên cạnh đó, việc sử dụng ngày càng nhiều công nghệ AI thay thế con người cũng đặt ra những thách thức đối với quyền làm việc. Quá trình tự động hóa, sử dụng công nghệ dẫn đến tình trạng thất nghiệp gia tăng. Nghiên cứu của hai học giả C.Frey và M.Osborne, Đại học Oxford cho thấy, khoảng 47% công việc tại Mỹ có nguy cơ bị AI chiếm giữ trong tương lai. Dự báo từ năm 2020 đến 2025, sẽ có hơn 85 triệu việc làm trên thế giới bị mất do công nghệ AI. Thị trường lao động bị ảnh hưởng không chỉ bởi giảm sút cơ hội việc làm, mà còn sự thay đổi về cơ cấu thị trường lao động, trong đó các công việc truyền thống ngày càng giảm sút, các công việc liên quan đến công nghệ ngày càng phổ biến; các nhóm yếu thế trong xã hội gặp khó khăn trong tiếp cận các công việc đòi hỏi trình độ, kỹ thuật cao.

|

| Hầu hết hệ thống AI được các công ty công nghệ như Google, Facebook, Twitter và nhiều chính phủ sử dụng. Ảnh: REUTERS |

Thách thức về vấn đề pháp lý

Theo các chuyên gia thuộc Viện Carnegie (Mỹ), pháp luật phải đóng vai trò kiểm soát AI nhằm phát huy những giá trị, lợi ích mang lại và giảm thiểu các hệ quả tiêu cực. Pháp luật bao gồm hệ thống quy tắc kiểm soát AI nhằm bảo đảm tất cả các chủ thể tham gia xây dựng, vận hành hệ thống AI phải có trách nhiệm thúc đẩy các quyền con người. Các chính phủ cần xây dựng hệ thống chính sách, pháp luật quy định; khuyến khích những doanh nghiệp phát triển AI bảo đảm trách nhiệm về nhân quyền, minh bạch và có trách nhiệm giải trình với hệ thống kiểm soát của mình trong việc sử dụng AI.

Để quản trị AI hiệu quả, pháp luật về lĩnh vực AI cần đặt trong bối cảnh toàn cầu, không chỉ cần đến “pháp luật cứng” truyền thống, mà phải nhờ đến hệ thống “pháp luật mềm” (các bộ quy tắc đạo đức, hướng dẫn, quy định của tổ chức quốc tế, hiệp hội). AI là hệ thống ứng dụng được xây dựng, vận hành trên phạm vi toàn cầu, có tác động ở mọi cấp độ (quốc tế, khu vực, quốc gia, địa phương) trên mọi lĩnh vực của đời sống xã hội, vì thế việc quản trị AI về quyền con người cần được coi là trách nhiệm toàn cầu. Việc xây dựng các chính sách, công ước và các quy tắc quốc tế về quản trị AI là nhiệm vụ cấp bách.

Với những đặc điểm của AI, pháp luật chính thống khó theo kịp để điều chỉnh các vấn đề liên quan, do vậy cần thêm nguồn “pháp luật mềm” bổ sung, đóng vai trò điều chỉnh, kiểm soát AI. Những năm qua, trên thế giới xuất hiện một số bộ nguyên tắc về AI. Đây là cách nhận biết và làm rõ vai trò của “pháp luật mềm” đối với pháp luật chính thức, cùng sự tham gia của các chủ thể đa dạng trong quản trị AI là một trong những định hướng nghiên cứu về pháp luật và quản trị AI thời gian tới.